V dnešnej digitálnej dobe sa informácie šíria rýchlosťou svetla a sťahovanie obsahu z webových stránok sa stalo bežnou praxou. Avšak, za fasádou ľahkého prístupu sa skrývajú komplexné technické výzvy, ktoré ovplyvňujú nielen prevádzkovateľov webových stránok, ale aj samotných používateľov. Jedným z takýchto problémov je aj fenomén nazývaný "scraping" alebo automatizované sťahovanie dát, ktorý môže mať nezanedbateľné dôsledky, najmä ak sa vykonáva vo veľkom meradle. V tomto článku sa ponoríme do hlbín tejto problematiky, pričom sa zameriame na to, ako aj zdanlivo nepatrné technické zaťaženia môžu pri masívnom nasadení dramaticky zvýšiť náklady a ako sa s týmto problémom vyrovnávajú moderné webové technológie.

Neviditeľná Záťaž: Ako Malé Zaťaženie Rastie do Obrovských Problémov

Na individuálnej úrovni môže byť dodatočné zaťaženie spôsobené skriptami na sťahovanie obsahu zanedbateľné. Pre bežného používateľa, ktorý si občas stiahne pár obrázkov alebo článkov, tieto procesy neznamenajú žiadny citeľný rozdiel v rýchlosti načítavania stránky alebo v spotrebe zdrojov. Problém však nastáva, keď sa toto "malé" zaťaženie znásobí na úrovni tisícok, či dokonca miliónov automatizovaných požiadaviek.

Predstavte si, že každá automatizovaná požiadavka na stiahnutie obsahu vyžaduje od servera vykonanie určitej série úloh. Tieto úlohy môžu zahŕňať analýzu HTML kódu, vykonávanie JavaScriptu, načítavanie externých zdrojov, spracovanie cookies a mnoho ďalších. Aj keď každá z týchto operácií sama o sebe spotrebuje len zlomok serverových zdrojov (CPU, pamäť, sieťová priepustnosť), pri masívnom zbernom skrapovaní sa tieto zlomky sčítajú. V konečnom dôsledku to vedie k extrémne zvýšeným nákladom na prevádzku serverov. Prevádzkovatelia webových stránok tak musia investovať do výkonnejšej infraštruktúry, drahších hostingových služieb a rozšírených bezpečnostných opatrení, aby zvládli nápor automatizovaných botov.

Tento koncept je podobný ako pri veľkovýrobe. Jedna malá skrutka v aute je zanedbateľná, ale miliardy skrutiek použitých v automobilovom priemysle predstavujú obrovskú spotrebu materiálu a energie. Podobne, hoci jedna skriptovaná požiadavka na webovú stránku je zanedbateľná, milióny takýchto požiadaviek generujú masívne zaťaženie.

Anubis a Moderné JavaScriptové Výzvy: Boj s Automatizáciou

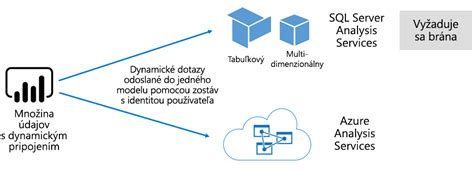

V reakcii na rastúci problém automatizovaného sťahovania obsahu vyvíjajú prevádzkovatelia webových stránok sofistikovanejšie metódy ochrany. Jedným z takýchto riešení je systém nazývaný Anubis. Anubis predstavuje pokročilý mechanizmus, ktorý sa snaží rozlíšiť medzi legitímnymi používateľmi a automatizovanými botmi. Jeho hlavnou myšlienkou je, že na individuálnej úrovni je dodatočné zaťaženie spôsobené jeho mechanizmami zanedbateľné pre bežného používateľa. Avšak pri masívnom nasadení skrapovacích nástrojov sa toto zaťaženie stáva významným, čím sa stáva pre botov oveľa drahším a menej efektívnym.

Kľúčovým prvkom Anubisu je jeho závislosť na moderných JavaScriptových funkciách. Tieto funkcie sú nevyhnutné pre správne fungovanie Anubisu, pretože umožňujú vykonávať komplexné operácie, ktoré sú ťažšie napodobiteľné pre jednoduché skriptovacie nástroje. Práve tu však nastáva paradox.

Pluginy ako JShelter, ktoré sú navrhnuté na zvýšenie súkromia a bezpečnosti používateľov, často fungujú tak, že obmedzujú alebo úplne zakazujú vykonávanie určitých JavaScriptových funkcií. Tieto funkcie môžu byť považované za potenciálne sledovacie alebo zberné. V kontexte Anubisu však tieto bezpečnostné opatrenia paradoxne narúšajú jeho fungovanie. Ak JShelter alebo podobný plugin zakáže moderné JavaScriptové funkcie, ktoré Anubis vyžaduje, potom Anubis nemôže správne fungovať a ochrana proti skrapovaniu je oslabená.

Fingerprinting a Identifikácia Bezhlavých Prehliadačov: Nová Generácia Ochrany

Anubis je v podstate "placeholder" riešenie, čo znamená, že slúži ako dočasné opatrenie. Jeho cieľom je poskytnúť čas na vývoj a implementáciu sofistikovanejších metód identifikácie automatizovaných procesov. Tieto pokročilejšie metódy sa zameriavajú na techniky nazývané "fingerprinting" (odfľakovanie).

Fingerprinting spočíva v zbere a analýze rôznych charakteristík prehliadača a jeho prostredia, aby sa vytvoril jedinečný "odtieň prsta" pre každé zariadenie alebo reláciu. Tieto charakteristiky môžu zahŕňať:

- Renderovanie fontov: Každý operačný systém a prehliadač vykresľuje písma mierne odlišne. Anubis a podobné systémy môžu analyzovať tieto drobné rozdiely, aby identifikovali, či ide o skutočný prehliadač alebo o bezhlavý prehliadač (headless browser), ktorý nemá grafické rozhranie a je často používaný na automatizáciu.

- Správanie pri načítavaní: Sledovanie, ako prehliadač načítava rôzne prvky stránky, ako reaguje na udalosti a ako interaguje s DOM (Document Object Model), môže odhaliť anomálie typické pre boty.

- Hardvérové a softvérové vlastnosti: Informácie o grafickej karte, rozlíšení obrazovky, dostupných hardvérových akceleráciách a dokonca aj o poradí, v akom sú načítavané JavaScriptové knižnice, môžu byť použité na identifikáciu.

- Sieťové charakteristiky: Analýza sieťových požiadaviek, ich časovania a vzorcov môže tiež pomôcť odhaliť automatizované správanie.

Cieľom fingerprintingu je vytvoriť systém, ktorý dokáže s vysokou presnosťou odlíšiť legitímnych používateľov od botov. Týmto spôsobom by sa mohlo predchádzať zobrazovaniu "challenge" stránok, ako je napríklad stránka s overením "nie som robot" (captcha alebo proof-of-work), pre používateľov, ktorí sú s najväčšou pravdepodobnosťou legitímni. Tým sa zároveň znižuje frustrácia používateľov a zlepšuje sa ich celková skúsenosť s webovou stránkou.

Od Zanedbateľného k Kritickému: Dopady na Ekosystém Webových Služieb

Problém automatizovaného sťahovania obsahu nie je len technickou výzvou pre prevádzkovateľov webových stránok. Má širšie dôsledky pre celý ekosystém digitálnych služieb:

- Zvýšené náklady pre všetkých: Ako už bolo spomenuté, vyššie prevádzkové náklady sa môžu premietnuť do cien služieb, predplatného alebo do obmedzenia dostupnosti obsahu pre používateľov.

- Narušenie trhu: Skrapovanie môže byť použité na nekalú konkurenciu, napríklad na zber cenových dát konkurentov, na kopírovanie obsahu alebo na manipuláciu s trhovými mechanizmami.

- Bezpečnostné riziká: Boty môžu byť zneužité na vykonávanie DDoS útokov, na šírenie spamu alebo na pokusy o získanie citlivých údajov.

- Vplyv na výskum a vzdelávanie: Na jednej strane, automatizované sťahovanie dát môže byť cenným nástrojom pre výskumníkov, ktorí analyzujú trendy, sentiment alebo iné vzorce v online dátach. Na druhej strane, nadmerné skrapovanie môže obmedziť prístup k týmto dátam pre akademickú obec.

Riešenia ako Anubis a pokročilé techniky fingerprintingu predstavujú snahu o nájdenie rovnováhy. Cieľom nie je úplne zablokovať automatizované procesy, pretože majú svoje legitímne využitie (napr. vyhľadávacie roboty, indexovanie obsahu), ale skôr zabrániť ich zneužívaniu na škodu prevádzkovateľov a legitímnych používateľov.

Budúcnosť Ochrany Obsahu: Neustály Závod v Inováciách

Technologický pokrok je neustály a s ním sa vyvíjajú aj metódy obchádzania bezpečnostných opatrení. Boty sa stávajú čoraz sofistikovanejšími, napodobňujúc ľudské správanie s neuveriteľnou presnosťou. Preto je vývoj v oblasti ochrany obsahu neustálym závodom v inováciách.

Budúce riešenia sa pravdepodobne zamerajú na kombináciu viacerých techník:

- Strojové učenie a umelá inteligencia: Analýza obrovského množstva dát o správaní používateľov na identifikáciu anomálií a predikciu potenciálnych hrozieb.

- Pokročilé overovacie mechanizmy: Okrem JavaScriptových výziev sa môžu objaviť nové formy overenia, ktoré sú založené na biometrii, správaní alebo dokonca na interakcii s inými službami.

- Decentralizované riešenia: Využitie technológií ako blockchain na overenie identity alebo na distribúciu záťaže, čím sa sťažuje centralizovaný útok.

- Dôraz na používateľskú skúsenosť: Cieľom bude vytvoriť systémy, ktoré sú čo najmenej invazívne pre legitímnych používateľov, pričom si zachovajú vysokú efektivitu proti botom.

Prípad Pilsner Urquell (ako metafora pre akúkoľvek značku alebo službu) a svätej pravdy (ako metafora pre skutočný, nefalšovaný obsah a interakciu) v kontexte webových technológií poukazuje na neustálu potrebu adaptácie. Ako sa technológie vyvíjajú, musia sa vyvíjať aj metódy ochrany, aby sa zabezpečila integrita digitálneho obsahu a spravodlivé prostredie pre všetkých účastníkov online priestoru. Boj proti masívnemu skrapovaniu je len jednou z mnohých výziev, ktorým čelia moderné webové služby, a jeho riešenie si vyžaduje neustálu pozornosť a inováciu.